AI: 24 ಮಿಲಿಯನ್ಗಿಂತಲೂ ಹೆಚ್ಚು ಜನರಿಂದ ವಿವಸ್ತ್ರಗೊಳಿಸುವ ಎಐ ಟೂಲ್ಸ್ ಬಳಕೆ: ಶಾಕಿಂಗ್ ವರದಿ!

ಇತ್ತೀಚಿನ ದಿನಗಳಲ್ಲಿ ಎಐ ಟೂಲ್ಸ್ (AI Tools) ಒಳ್ಳೆಯದಕ್ಕೆ ಉಪಯೋಗ ಆಗುವುದಕ್ಕಿಂತ ಕೆಟ್ಟ ವಿಷಯಕ್ಕೇ ಹೆಚ್ಚು ಬಳಕೆ ಆಗುತ್ತಿದೆ. ಈ ಸಂಬಂಧ ಹಲವಾರು ಜನರು ಆತಂಕ ಸಹ ಹೊರಹಾಕಿದ್ದಾರೆ. ಈ ಬೆಳವಣಿಗೆ ನಡುವೆ ಅಚ್ಚರಿ ವರದಿಯೊಂದು ಹೊರಬಿದ್ದಿದ್ದು, ಮಹಿಳೆಯರ ಫೋಟೋಗಳನ್ನು ಕೆಟ್ಟದಾಗಿ ಅಂದರೆ ಅಶ್ಲೀಲವಾಗಿ ವೀಕ್ಷಣೆ ಮಾಡಲು ಎಐ ಟೂಲ್ಸ್ ಅನ್ನು ಹೆಚ್ಚಾಗಿ ಬಳಕೆ ಮಾಡಲಾಗುತ್ತಿದೆಯಂತೆ.

ಹೌದು, 24 ಮಿಲಿಯನ್ಗಿಂತಲೂ ಹೆಚ್ಚು ಜನರು ಈ ರೀತಿಯ ಕೆಟ್ಟ ಕೆಲಸಕ್ಕೆ ಕೈ ಹಾಕಿದ್ದಾರೆ ಎಂಬ ಅಚ್ಚರಿ ಮಾಹಿತಿಯನ್ನು ಈಗ ಬಹಿರಂಗಪಡಿಸಲಾಗಿದೆ. ಈ ಜನರು ಫೋಟೋಗಳಲ್ಲಿ ಮಹಿಳೆಯರನ್ನು ವಿವಸ್ತ್ರಗೊಳಿಸಲು ಎಐ ಟೂಲ್ಸ್ ಅನ್ನು ಬಳಕೆ ಮಾಡುತ್ತಿದ್ದಾರಂತೆ. ಹಾಗಿದ್ರೆ, ಏನಿದು ವಿಚಿತ್ರ ಬೆಳವಣಿಗೆ, ಎಐ ಈಗ ಎಷ್ಟು ಮಾರಕ ಅನ್ನೋದನ್ನು ಈ ಲೇಖನದಲ್ಲಿ ತಿಳಿಸಿಕೊಡಲಾಗಿದೆ ಓದಿರಿ.

ವಿವಸ್ತ್ರಗೊಳ್ಳುವ ವೆಬ್ಸೈಟ್ಗಳಿಗೆ ಹೆಚ್ಚಿನ ಜನರ ಭೇಟಿ: ಸಾಮಾಜಿಕ ನೆಟ್ವರ್ಕ್ ವಿಶ್ಲೇಷಣಾ ಕಂಪನಿಯಾದ ಗ್ರಾಫಿಕಾ (Graphika) ಈ ಬಗ್ಗೆ ವರದಿ ನೀಡಿದೆ. ಸೆಪ್ಟೆಂಬರ್ನಲ್ಲಿ 24 ಮಿಲಿಯನ್ ಜನರು ಫೋಟೋಗಳಲ್ಲಿ ಇರುವ ಮಹಿಳೆಯರನ್ನು ವಿವಸ್ತ್ರಗೊಳಿಸುವ ವೆಬ್ಸೈಟ್ಗಳಿಗೆ ಭೇಟಿ ನೀಡಿದ್ದಾರೆ ಎಂದು ಬಹಿರಂಗಪಡಿಸಿದೆ. ಈ ಮೂಲಕ ಕೃತಕ ಬುದ್ಧಿಮತ್ತೆಯ ಪ್ರಗತಿಯಿಂದ ಒಪ್ಪಿಗೆಯಿಲ್ಲದ ಅಶ್ಲೀಲತೆಯ ತೊಂದರೆಯ ಉಲ್ಬಣವನ್ನು ಎತ್ತಿ ತೋರಿಸಲಾಗಿದೆ.

ಇನ್ನು ಫೋಟೋಗಳಲ್ಲಿ ಮಹಿಳೆಯರನ್ನು ವಿವಸ್ತ್ರಗೊಳಿಸಲು ಕೃತಕ ಬುದ್ಧಿಮತ್ತೆಯನ್ನು ಬಳಸುವ ಆಪ್ಗಳು ಮತ್ತು ವೆಬ್ಸೈಟ್ಗಳ ಜನಪ್ರಿಯತೆಯ ಹೆಚ್ಚಳವು ಸಂಶೋಧಕರು ಮತ್ತು ಇತರೆ ಅಧಿಕಾರಿಗಳ ಗಮನ ಸೆಳೆದಿದೆ ಎಂದು ಬ್ಲೂಮ್ಬರ್ಗ್ನ ವರದಿಯಲ್ಲಿ ಉಲ್ಲೇಖ ಮಾಡಲಾಗಿದೆ. ಅದರಲ್ಲೂ ನ್ಯೂಡಿಫೈ ಎಂದು ಕರೆಯಲ್ಪಡುವ ಸೇವೆಗಳು ಮಾರ್ಕೆಟಿಂಗ್ಗಾಗಿ ಜನಪ್ರಿಯ ಸಾಮಾಜಿಕ ನೆಟ್ವರ್ಕ್ಗಳನ್ನು ಬಳಕೆ ಮಾಡಿಕೊಳ್ಳುತ್ತಿವೆಯಂತೆ. ಅದರಲ್ಲೂ ಎಕ್ಸ್ ನಲ್ಲೇ ಇದು ಹೆಚ್ಚಳವಾಗಿದೆ.

ಈ ಸೇವೆಗಳು ಎಐ ತಂತ್ರಜ್ಞಾನವನ್ನು ಬಳಕೆ ಮಾಡಿಕೊಂಡು ವ್ಯಕ್ತಿಗಳನ್ನು ಡಿಜಿಟಲ್ ಆಗಿ ವಿವಸ್ತ್ರಗೊಳಿಸುತ್ತವೆ. ಅದರಲ್ಲೂ ಇದನ್ನು ಮಹಿಳೆಯರ ಮೇಲೆ ಹೆಚ್ಚು ಕೇಂದ್ರೀಕರಿಸಲಾಗಿದೆ. ಈ ರೀತಿಯ ಘಟನೆಗಳು ಗಂಭೀರ ಕಾನೂನು ಮತ್ತು ನೈತಿಕ ಸವಾಲುಗಳನ್ನು ಹೊಂದಿದ್ದು, ಇದಕ್ಕಾಗಿ ಯಾರ ಒಪ್ಪಿಗೆಯೂ ಇಲ್ಲದೆ ಸಾಮಾಜಿಕ ಜಾಲತಾಣದಲ್ಲಿ ಫೋಟೋ ಅಥವಾ ವಿಡಿಯೋಗಳನ್ನು ತೆಗೆದುಕೊಂಡು ಈ ಕೃತ್ಯ ಎಸಗಲಾಗುತ್ತಿದೆ ಎಂದು ವರದಿಯಲ್ಲಿ ಉಲ್ಲೇಖಿಸಲಾಗಿದೆ.

ಸಾಮಾನ್ಯ ಜನರಿಗೆ ಭಯ: ಈ ರೀತಿಯ ಘಟನೆಗಳು ಸಂಭಾವ್ಯ ಕಿರುಕುಳಕ್ಕೆ ಕಾರಣವಾಗಬಹುದು ಎಂದು ಸಂಶೋಧಕರು ಎಚ್ಚರಿದ್ದಾರೆ. ಕಿಡಿಗೇಡಿಗಳು ನಗ್ನ ಚಿತ್ರಗಳನ್ನು ಕ್ರಿಯೇಟ್ ಮಾಡಿ ಸಾಮಾನ್ಯ ವ್ಯಕ್ತಿಗೆ ಕಳುಹಿಸುವ ಮೂಲಕ ಅವರಿಂದ ಹಣ ಪಡೆಯುವುದು ಅಥವಾ ಇನ್ಯಾವುದೇ ರೀತಿಯಲ್ಲಿ ಹಿಂಸಾಚಾರ ಮಾಡಬಹುದು ಎಂದು ಹೇಳಲಾಗಿದೆ. ಈ ಬೆಳವಣಿಗೆ ನಡುವೆ ಅಶ್ಲೀಲ ಕಂಟೆಂಟ್ ವಿರುದ್ಧ ಗೂಗಲ್ ತನ್ನ ನೀತಿಯನ್ನು ಒತ್ತಿ ಹೇಳಿದ್ದು, ನಿಯಮ ಉಲ್ಲಂಘಿಸುವ ಕಂಟೆಂಟ್ ಅನ್ನು ಸಕ್ರಿಯವಾಗಿ ತೆಗೆದುಹಾಕುತ್ತಿದೆ. ಆದರೆ, ಎಕ್ಸ್ ಮತ್ತು ರೆಡ್ಡಿಟ್ ನಲ್ಲಿ ಈ ಕೆಲಸ ಇನ್ನೂ ಆರಂಭ ಆಗಿಲ್ಲ.

ಎಐ ತಂತ್ರಜ್ಞಾನದಲ್ಲಿನ ಪ್ರಗತಿಯಿಂದ ಆದ ಡೀಪ್ಫೇಕ್ ಬಗ್ಗೆ ಗೌಪ್ಯತೆ ತಜ್ಞರು ಎಚ್ಚರಿಕೆ ನೀಡುತ್ತಲೇ ಇದ್ದಾರೆ. ಎಲೆಕ್ಟ್ರಾನಿಕ್ ಫ್ರಾಂಟಿಯರ್ ಫೌಂಡೇಶನ್ನ ಸೈಬರ್ ಸೆಕ್ಯುರಿಟಿ ನಿರ್ದೇಶಕರಾದ ಇವಾ ಗಾಲ್ಪೆರಿನ್ ಅವರು ಈ ಬಗ್ಗೆ ಮಾಹಿತಿ ನೀಡಿ, ಹೈಸ್ಕೂಲ್ ಮತ್ತು ಕಾಲೇಜು ವಿದ್ಯಾರ್ಥಿಗಳು ಇದಕ್ಕೆ ಗುರುಯಾಗುತ್ತಿದ್ದಾರೆ. ಆದರೆ ಅನೇಕ ಬಲಿಪಶುಗಳಿಗೆ ಈ ಕುಶಲತೆಯ ಚಿತ್ರಗಳ ಬಗ್ಗೆ ತಿಳಿದಿಲ್ಲದಿರಬಹುದು ಅಥವಾ ಕಾನೂನು ಕ್ರಮವನ್ನು ಅನುಸರಿಸುವಲ್ಲಿ ಅವರು ಸವಾಲುಗಳನ್ನು ಎದುರಿಸಬಹುದು ಎಂದು ಕಳವಳ ವ್ಯಕ್ತಪಡಿಸಿದ್ದಾರೆ.

ಈ ರೀತಿಯ ಪ್ರಕರಣ ಹೆಚ್ಚಾಗುತ್ತಿದ್ದರೂ ಸಹ ಯುನೈಟೆಡ್ ಸ್ಟೇಟ್ಸ್ನಲ್ಲಿ ಯಾವುದೇ ಫೆಡರಲ್ ಕಾನೂನು ಡೀಪ್ಫೇಕ್ ಅಶ್ಲೀಲತೆಯ ರಚನೆಯನ್ನು ಸ್ಪಷ್ಟವಾಗಿ ನಿಷೇಧಿಸಿಲ್ಲ. ಆದರೂ ನಾರ್ತ್ ಕೆರೊಲಿನಾದಲ್ಲಿನ ರೋಗಿಗಳ ಫೋಟೋ ಬಳಕೆ ಮಾಡಿಕೊಂಡು ಅವರನ್ನು ಡಿಜಿಟಲ್ನಲ್ಲಿ ವಿವಸ್ತ್ರಗೊಳಿಸಲು ಆಪ್ ಬಳಸಿದ್ದಕ್ಕಾಗಿ ಮಕ್ಕಳ ಮನೋವೈದ್ಯರಿಗೆ ಬರೋಬ್ಬರಿ 40 ವರ್ಷಗಳ ಶಿಕ್ಷೆ ವಿಧಿಸಲಾಗಿದೆ.

ಗಮಿಸಬೇಕಾದ ವಿಷಯ ಏನೆಂದರೆ ಟಿಕ್ಟಾಕ್ ಮತ್ತು ಮೆಟಾ ಪ್ಲಾಟ್ಫಾರ್ಮ್ಗಳು ಈ ವಿವಸ್ತ್ರಗೊಳಿಸುವ ಆಪ್ಗಳಿಗೆ ಸಂಬಂಧಿಸಿದಂತೆ ಕೀವರ್ಡ್ಗಳನ್ನು ನಿರ್ಬಂಧಿಸಲು ಕ್ರಮಗಳನ್ನು ತೆಗೆದುಕೊಂಡಿವೆ. ಟಿಕ್ಟಾಕ್ ತನ್ನ ಬಳಕೆದಾರರಿಗೆ ಎಚ್ಚರಿಕೆ ನೀಡಿದ್ದು, ವಿವಸ್ತ್ರಗೊಳಿಸು (undress) ಪದವು ಅದರ ಮಾರ್ಗಸೂಚಿಗಳನ್ನು ಉಲ್ಲಂಘಿಸುವ ಕಂಟೆಂಟ್ನೊಂದಿಗೆ ಸಂಬಂಧ ಹೊಂದಿರಬಹುದು ಎಂದು ತಿಳಿಸಿದೆ.

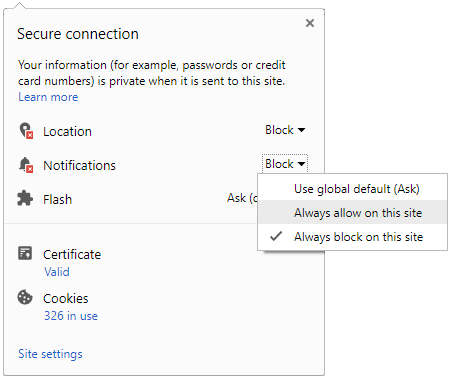

Click it and Unblock the Notifications

Click it and Unblock the Notifications

-1763362932432.svg)